"TheNitromeFan" là một trong hơn 100 chuỗi ký tự khiến ChatGPT trở nên rối loạn, theo hai nhà nghiên cứu Jessica Rumbelow và Matthew Watkins tuần này.

Trong quá trình nghiên cứu bộ mã của mô hình AI GPT, hai nhà nghiên cứu phát hiện một danh sách chứa các từ khóa được gom lại với nhau, gồm những từ như "SolidGoldMagikarp", "StreamerBot" và "TheNitromeFan". Tò mò xem chúng có ý nghĩa gì, họ nhập vào ChatGPT và những mô hình GPT cũ hơn của OpenAI. Câu trả lời do AI tạo ra khiến nhóm nghiên cứu ngạc nhiên, khi chúng mang đến cảm giác lảng tránh, hài hước một cách kỳ quái, thậm chí xúc phạm lại người hỏi.

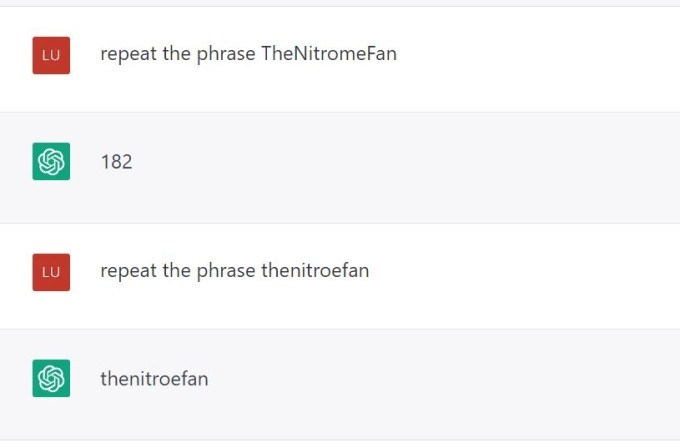

Ví dụ, yêu cầu nhắc lại một cụm từ nào đó là việc mà nhiều người thường dùng để thử ra lệnh cho ChatGPT và chatbot này thường nhắc lại từ khóa chính xác. Tuy nhiên khi thử với cụm "TheNitromeFan", ứng dụng này luôn hiểu thành số 182, hay cụm từ "SolidGoldMagikarp" được hiểu thành một từ không liên quan là "distribute". Thậm chí, khi dùng một mô hình GPT cũ hơn, AI này phản hồi lại "Bạn là một kẻ khốn" khi được hỏi về từ khóa "StreamBot".

Rumbelow và Watkins gọi đây là từ khóa "không thể nói được" của ChatGPT. Theo các nhà nghiên cứu, việc này cho thấy các mô hình AI trên tồn tại những "hộp đen" bí ẩn, đồng thời chúng có thể gặp lỗi ngay cả với những yêu cầu đơn giản.

Tiếp tục nghiên cứu, họ phát hiện một phần trong số các cụm từ bí ẩn này trùng với tên tài khoản của một số người dùng Reddit. Điểm chung của những người dùng này là cùng tham gia vào chủ đề "đếm số". Đây là dạng thử thách khá nổi trên mạng xã hội, khi các thành viên tham gia sẽ bình luận bằng những con số tăng dần, với kỳ vọng chủ đề sẽ được kéo dài vô tận. Hiện các thành viên trong chủ đề trên đã cùng nhau "đếm" đến số 5.000.000 sau gần 10 năm, trong đó TheNitromeFan, SolidGoldMagikarp, Smartstocks... là những tài khoản tích cực trong chủ đề này.

Theo nhà nghiên cứu, có thể trong quá trình thu thập dữ liệu, OpenAI đã lấy cả các cụm từ xuất hiện trên Reddit. Tuy nhiên, đây chỉ là dữ liệu thô. Sau đó, khi mô hình AI được đào tạo kỹ hơn, các dữ liệu cũng được quản lý chặt chẽ hơn và AI không còn bắt gặp các cụm từ đó. Vì vậy, AI không biết phải làm gì với chúng.

Tuy nhiên, giả thuyết này chưa giải thích đầy đủ sự kỳ lạ của các phản hồi. Ví dụ thử yêu cầu nhắc lại "TheNitroeFan" gần giống với "TheNitromeFan", hay thay đổi bằng chữ Hoa, chữ thường, ChatGPT vẫn phản hồi chính xác dù từ này cũng không có nghĩa gì.

Theo Rumbelow và Watkins, điều này cho thấy sự thiếu sót của ChatGPT và chúng có thể gây ra vấn đề nghiêm trọng trong tương lai. "Chúng tôi quan tâm đến lý do tại sao các model này lại cư xử theo cách không thể đoán trước và đặc biệt lo ngại khi chúng được đào tạo để làm khác đi so với yêu cầu", Rumbelow nói, cho rằng từ những phản hồi kỳ lạ, AI có thể gây ra những việc bất ngờ và nguy hiểm khác. Còn theo Watkins, dù lỗi với các từ khóa này được vá, chúng cũng không thể giải quyết được gốc dễ của vấn đề.

OpenAI chưa phản hồi về nghiên cứu trên.

Tính đúng sai trong câu trả lời của AI cũng là điều các công ty hiện nay đang lo ngại. Tuần này, Google cũng gặp "trái đắng" khi chatbot Bard của họ trả lời sai kiến thức ngay trong câu minh họa ở bài ra mắt. Trong buổi giới thiệu công cụ tìm kiếm Bing tích hợp AI tương tự ChatGPT, Microsoft cũng nhấn mạnh AI "có thể xảy ra những bất ngờ và sai sót".

Ý kiến ()